您所在的位置:首页 - 热点 - 正文热点

编写spark程序

![]() 淳潇

2024-05-16

【热点】

498人已围观

淳潇

2024-05-16

【热点】

498人已围观

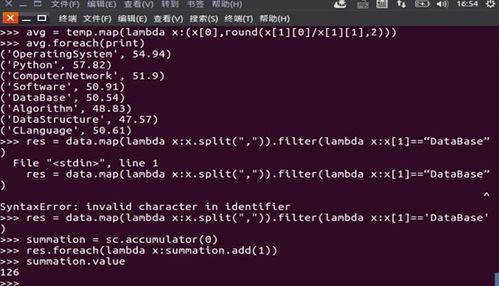

摘要#Spark编程题解析与解答##1.根据条件筛选数据并进行聚合假设有一个包含员工信息的RDD,包括员工姓名、部门和工资,现需要根据部门筛选出工资大于5000的员工,并计算每个部门工资大于5000的员工

Spark编程题解析与解答

1. 根据条件筛选数据并进行聚合

假设有一个包含员工信息的RDD,包括员工姓名、部门和工资,现需要根据部门筛选出工资大于5000的员工,并计算每个部门工资大于5000的员工人数和平均工资。

```scala

val employeeData = sc.parallelize(Seq(

("Alice", "HR", 6000),

("Bob", "Engineering", 5500),

("Charlie", "HR", 4800),

("David", "Sales", 5100),

("Eve", "Engineering", 6200)

))

val filteredEmployees = employeeData.filter{ case (name, department, salary) => salary > 5000 }

val departmentStats = filteredEmployees.map{ case (name, department, salary) => (department, (1, salary)) }

.reduceByKey{ case ((count1, sum1), (count2, sum2)) => (count1 count2, sum1 sum2) }

.mapValues{ case (count, totalSalary) => (count, totalSalary / count) }

```

在这个例子中,我们首先使用`filter`方法筛选出工资大于5000的员工,然后使用`map`方法构建部门员工人数和工资统计的键值对,接着使用`reduceByKey`方法按部门进行聚合并计算总人数和总工资,最后使用`mapValues`方法计算平均工资。

2. 读取文本文件并统计单词频次

假设有一个文本文件,需要使用Spark读取该文件并统计每个单词出现的频次,然后按频次降序排列并输出前10个单词和对应的频次。

```scala

val textFile = sc.textFile("hdfs://path/to/your/textfile.txt")

val wordCounts = textFile.flatMap(line => line.split(" "))

.map(word => (word, 1))

.reduceByKey(_ _)

val top10Words = wordCounts.map{ case (word, count) => (count, word) }

.sortByKey(false)

.take(10)

.map{ case (count, word) => (word, count) }

```

在这个例子中,我们首先使用`textFile`方法读取文本文件,然后使用`flatMap`方法将每行文本拆分成单词并转换成 `(word, 1)` 键值对的形式,接着使用`reduceByKey`方法对相同单词进行统计计数,最后使用`sortByKey`方法按频次降序排列并取前10个单词。

3. 使用Spark SQL对数据进行查询与分析

假设有一个包含用户购买记录的数据表,并且需要统计每个用户的总消费金额并按消费金额降序排列。

```scala

import org.apache.spark.sql.SparkSession

val spark = SparkSession.builder().appName("UserPurchaseAnalysis").getOrCreate()

// 读取数据并创建临时视图

val purchaseData = spark.read.csv("hdfs://path/to/your/purchase_data.csv")

purchaseData.createOrReplaceTempView("purchases")

// 执行SQL查询

val purchaseSummary = spark.sql("SELECT user_id, SUM(amount) AS total_spent FROM purchases GROUP BY user_id ORDER BY total_spent DESC")

purchaseSummary.show()

```

在这个例子中,我们首先使用`SparkSession`创建Spark SQL会话,然后使用`read`方法读取购买记录数据并创建临时视图,接着使用`sql`方法执行SQL查询,统计每个用户的总消费金额并按消费金额降序排列,最后使用`show`方法展示查询结果。

以上是三个常见的Spark编程题的解答与解析,希望能帮助你更好地理解Spark编程。

Tags: 洛奇英雄传好玩吗 豆豆小说阅读网 大字报字体 三国杀移动版

版权声明: 免责声明:本网站部分内容由用户自行上传,若侵犯了您的权益,请联系我们处理,谢谢!联系QQ:2760375052

最近发表

- 特朗普回应普京涉乌言论,强硬立场引发争议与担忧

- 民营企业如何向新而行——探索创新发展的路径与实践

- 联合国秘书长视角下的普京提议,深度解析与理解

- 广东茂名发生地震,一次轻微震动带来的启示与思考

- 刀郎演唱会外,上千歌迷的守候与共鸣

- 东北夫妻开店遭遇刁难?当地回应来了

- 特朗普惊人言论,为夺取格陵兰岛,美国不排除动用武力

- 超级食物在中国,掀起健康热潮

- 父爱无声胜有声,监控摄像头背后的温情呼唤

- 泥坑中的拥抱,一次意外的冒险之旅

- 成品油需求变天,市场趋势下的新机遇与挑战

- 警惕儿童健康隐患,10岁女孩因高烧去世背后的警示

- 提振消费,新举措助力消费复苏

- 蒙牛净利润暴跌98%的背后原因及未来展望

- 揭秘缅甸强震背后的真相,并非意外事件

- 揭秘失踪的清华毕业生罗生门背后的悲剧真相

- 冷空气终于要走了,春天的脚步近了

- 李乃文的神奇之笔,与和伟的奇妙转变

- 妹妹发现植物人哥哥离世后的崩溃大哭,生命的脆弱与情感的冲击

- 云南曲靖市会泽县发生4.4级地震,深入了解与应对之道

- 缅甸政府部门大楼倒塌事件,多名官员伤亡,揭示背后的故事

- 多方合力寻找失踪的十二岁少女,七天生死大搜寻

- S妈情绪崩溃,小S拒绝好友聚会背后的故事

- 缅甸遭遇地震,灾难之下的人间故事与影响深度解析

- 缅甸地震与瑞丽市中心高楼砖石坠落事件揭秘

- 揭秘ASP集中营,技术成长的摇篮与挑战

- 徐彬,整场高位压迫对海港形成巨大压力——战术分析与实践洞察

- ThreadX操作系统,轻量、高效与未来的嵌入式开发新选择

- 王钰栋脚踝被踩事件回应,伤势并不严重,一切都在恢复中

- 刘亦菲,粉色花瓣裙美神降临

- 三星W2018与G9298,高端翻盖手机的对比分析

- 多哈世乒赛器材,赛场内外的热议焦点

- K2两厢车,小巧灵活的城市出行神器,适合你的生活吗?

- 国家市监局将审查李嘉诚港口交易,聚焦市场关注焦点

- 提升知识水平的趣味之旅

- 清明五一档电影市场繁荣,多部影片争相上映,你期待哪一部?

- 美联储再次面临痛苦抉择,权衡通胀与经济恢复

- 家庭千万别买投影仪——真相大揭秘!

- 文物当上网红后,年轻人的创意与传承之道

- 手机解除Root的最简单方法,安全、快速、易操作

- 缅甸地震与汶川地震,能量的震撼与对比

- 2011款奥迪A8,豪华与科技的完美结合

- 广州惊艳亮相,可折叠电动垂直起降飞行器革新城市交通方式

- 比亚迪F3最低报价解析,性价比之选的购车指南

- 商业健康保险药品征求意见,行业内外视角与实用建议

- 官方动态解读,最低工资标准的合理调整

- 东风标致5008最新报价出炉,性价比杀手来了!

- 大陆配偶在台湾遭遇限期离台风波,各界发声背后的故事与影响

- 奔驰C级2022新款,豪华与科技的完美融合

- 大摩小摩去年四季度对A股的投资热潮